作者 | 香草

编辑 | 李水青

根据智东西在6月28日的报道,百度在2024年WAVE SUMMIT深度学习开发者大会上,正式推出文心大模型4.0 Turbo版本,同时网页端和API接口已同步上线,App端也将在不久后推出。

▲文心大模型4.0 Turbo API开放

与此同时,飞桨平台也推出了全新的飞桨框架3.0 Beta版本,具备大模型训练与推理一体化、动态静态统一自动并行、编译器的自动化优化以及对多种硬件的大模型适配等功能。

百度智能代码助手Baidu Comate已升级至2.5版本,显著提升了开发和业务迭代的效率,同时更换了全新的中文名称“文心快码”,正式加入百度的“文心大家族”。

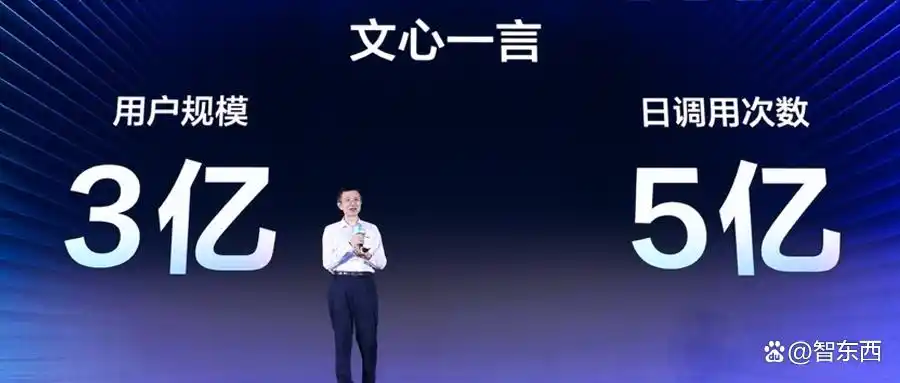

百度首席技术官王海峰表示,文心一言的用户数量现已超过3亿,每天的调用次数也超过5亿;而飞桨平台至今已服务1465万开发者和37万企业,构建了超过95万个模型。

一、用户规模突破3亿,文心大模型4.0 Turbo上线

经过多年的发展,人工智能技术经历了从人工规则编写到统计机器学习,再到深度学习和大模型时代的演变,算法与模型已变得愈加通用和统一。

王海峰指出,大模型为人工智能通用智能(AGI)带来了希望,可以从两个方面来理解:一是AI技术的通用性,二是AI能力的全面性。全面的AI能力主要涵盖理解、逻辑推理、生成和记忆等四个方面。

2019年3月,百度首次推出了文心大模型1.0,并经过多次版本更新,至2022年10月推出了4.0版本。目前,文心一言的用户总数已达到3亿,日均调用次数高达5亿次。

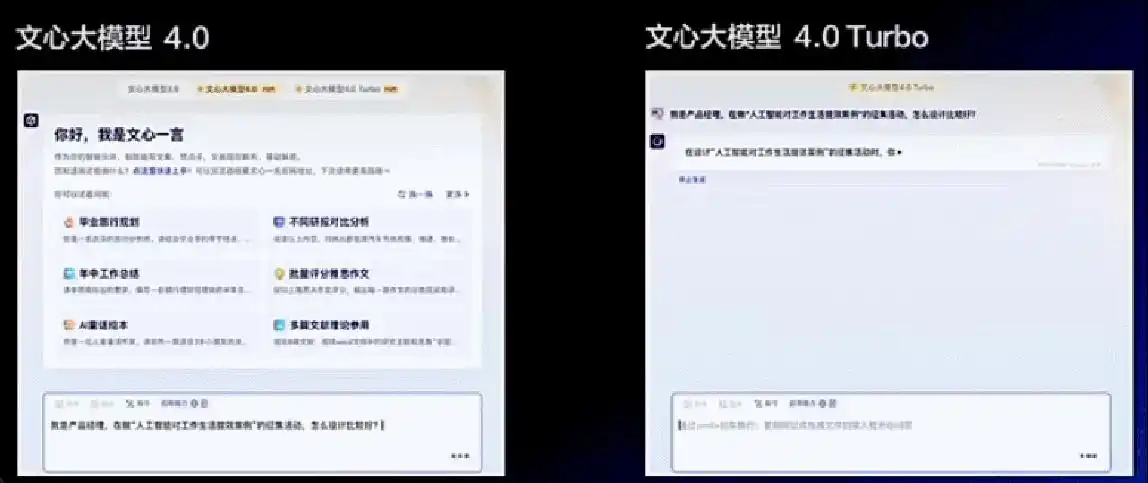

今天,百度发布了文心大模型4.0 Turbo版本,用户现在可以通过网页和API进行访问,移动应用程序也将在不久后上线,企业客户可通过百度智能云的千帆大模型平台调用相关API服务。

▲文心大模型4.0 Turbo发布

文心4.0 Turbo在生成速度和效果上有了显著提升。王海峰现场展示了与4.0版本的对比,结果显示,在相同的提示条件下,4.0 Turbo的生成速度更快,生成内容结构更为清晰。

▲文心4.0 Turbo与文心4.0生成速度对比

在基础模型的升级方面,百度进一步开发了智能体(Agent)机制,涵盖理解、规划、反思和进化等功能,使其能够有效执行任务、实现自我进化,并在一定程度上将思考过程透明化,让大模型模仿人类的思维和行动,独立使用工具完成复杂任务,并在环境中不断学习以实现自主进化。

▲基于文心大模型的智能体升级

百度还与中国工程院院士朱有勇及其团队联合开发了首个农业智能体“农民院士智能体”,该智能体基于文心智能体平台构建,融合了朱院士的研究成果及相关农业知识,为农民在生产和生活中提供解答。

▲农民院士智能体

文心大模型的惊人进展与飞桨3.0的发布

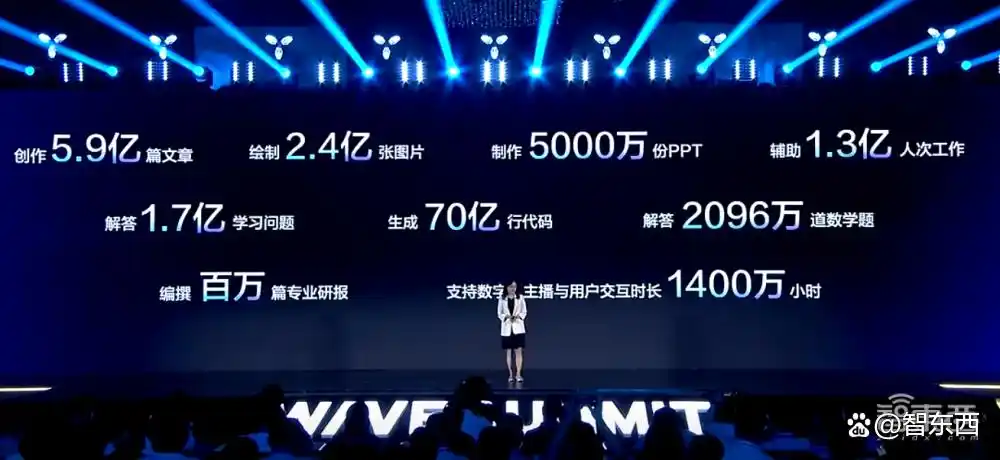

百度集团的副总裁吴甜指出,过去六个月中,用户对文心大模型的提问频率显著上升,日均提问量增长了78%,而提问的平均字数也提高了89%。这表明用户在使用中逐渐倾向于更为复杂和具体的提示词。

基于文心大模型的创新应用层出不穷,截至目前,文心一言已成功创作了5.9亿篇文章,生成了2.4亿幅图片,并且创造了70亿行代码,帮助了1.3亿人次的工作。

▲文心大模型的综合成就

吴甜还分享了文心大模型星河共创计划的成果,自去年8月启动以来,已经开发出1000多个大模型工具,超过55万个AI应用,并积累了超过1000亿的高质量数据。

例如,百度与长光卫星技术有限公司联合推出的共生地球智能助手,在上线的第一个月内便服务了3.1万名用户,解答了超过3.8万次的遥感技术问题。

飞桨3.0测试版的推出:四层框架与优势

飞桨是百度推出的开源深度学习平台,王海峰介绍称,该平台已经为1465万开发者和37万家企业提供服务,并创建了高达95万个模型。

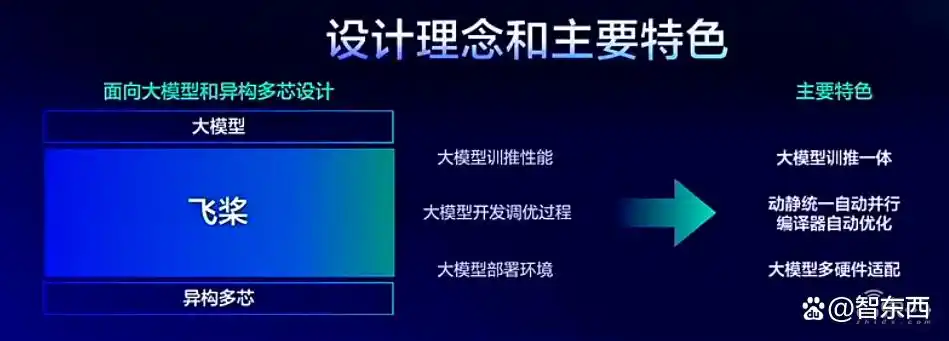

今天,飞桨3.0 Beta版本正式发布,具有动静统一自动并行、编译器自动优化、大模型多硬件适配以及大模型训练推理一体化等四大显著特点。

▲百度飞桨3.0 Beta版本

在设计理念上,飞桨充分考虑了大模型和异构多芯片的发展趋势,为了优化大模型的训练和推理性能,同时简化开发调试过程,飞桨与文心紧密结合,在这两个方面进行了专门的优化。

▲飞桨框架设计理念概述

具体而言,通过极简化的开发流程,飞桨实现了动静统一的自动并行能力,从而使大模型能够进行混合并行训练。这一创新大幅度减少了分布式训练的核心代码量,下降幅度超过50%,并且在典型模型的训练性能上提升了20%。

编译器的自动优化功能有效支持大模型与AI科学计算,通过整体设计提升了通用模型的训练效率,使得大模型的推理性能提升了30%,而在典型科学计算模型的求解速度上,领先了71%。

▲编译器的自动优化功能

在适配多种硬件的过程中,飞桨通过低成本的硬件接入实现了软硬件的协同优化。开发人员只需适配30多个接口,即可全面支持大模型的训练、压缩及推理。

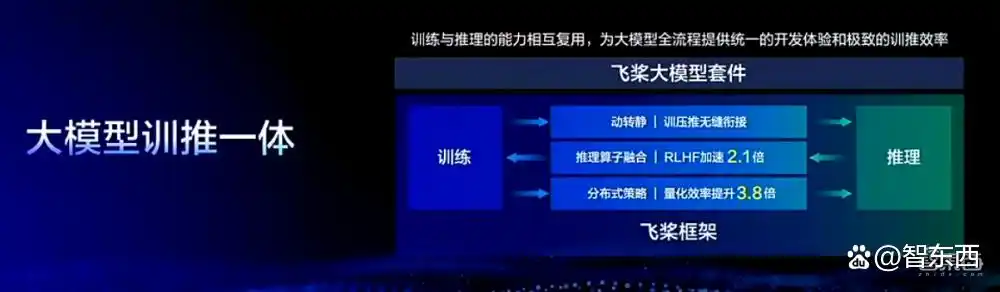

飞桨框架3.0的核心特征在于其实现了大模型训练与推理的一体化,采用无缝连接的方式,使得RLHF训练复用推理引擎的速度提升了2.1倍,而量化压缩的复用分布式策略效率则提高了3.8倍。

▲大模型训练与推理一体化

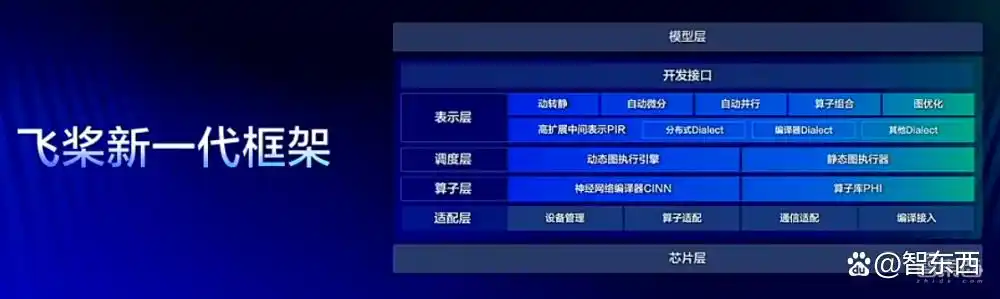

从整体架构来看,飞桨3.0被分为表示层、调度层、算子层以及适配层共四个层次。特别值得一提的是,飞桨3.0的开发接口与2.0版本保持了完全的兼容性,用户无需重新编写代码。

▲飞桨3.0框架结构

飞桨与智能代码助手的创新进展

飞桨在AI for Science方面进行了深入优化,成功支持超过130个主流科学计算库的模型。这些模型能够覆盖数据、机理与数理融合的全球求解模式,从而为科学问题的分析提供广泛支持。特别是,采用高阶自动微分和编译优化技术的方程求解类模型,其解算速度相较于PyTorch平均快出71%。

智能代码助手Comate升级至2.5版本,服务覆盖百度80%程序员

在近日的发布会上,百度的副总裁陈洋宣布了智能代码助手Comate的2.5版本。此次升级使得代码助手集成了更多的研发知识,流程覆盖也更加全面。

▲百度智能代码助手Comate版本2.5升级

此外,这款助手还获得了中文名称——文心快码,正式融入百度文心的大家族中。

陈洋指出,文心快码的“快”体现了三个方面:开发速度迅速、业务迭代迅速、企业落地迅速。

▲文心快码2.5版本

具体而言,在提升开发速度方面,文心快码整合了大量研发知识,涵盖数百位技术专家的实践经验、十亿级的研发领域知识以及上万家企业的实际研发场景。

在百度内部的应用中,利用文心快码生成的开发框架代码的准确率达到了80%,而单位时间内提交的代码数量则提升了35%。

▲文心快码的开发速度显著提升

文心快码:推动研发效率的革命性工具

文心快码在业务迭代方面展现出了无与伦比的整合能力,涵盖了从需求调研、设计到代码编写、测试和发布等各个研发环节。

据陈洋所述,借助文心快码,百度研发环节中的代码编写时间被压缩至仅1.74秒,部署脚本的自动生成速度达到了秒级,线下环境的部署时间减少了10分钟以上。总体来看,单个工程师的研发效率提升超过14%。

▲文心快码提升业务迭代速度

在企业实际应用层面,文心快码针对行业标准的差异、企业的私有知识、以及代码助手与内部工具的结合等问题,提供了安全、可靠并且适应业务需求的解决方案。

经过一年的实践,文心快码在百度内部的覆盖率已经达到80%,其生成代码的实际应用率为46%,新增代码生成占比为29%。

陈洋还分享了与标杆客户喜马拉雅的成功合作案例,该公司在仅一个季度内实现了90%的工程师覆盖率,代码采纳率为44%,新增代码生成占比则达到了33%。

▲文心快码企业落地案例展示

喜马拉雅的CTO姜杰表示,文心快码与其自身积累的研发能力和知识相结合,有效缩短了技术调研及代码编写所需的时间,显著提升了整体研发效率和产品质量。

目前,文心快码推出了标准版、专业版、企业版和专有版四个版本,其中专业版专为专业开发者限时开放,基础功能和高级功能均可无限制使用。

结语:人工智能迈入工业生产的新阶段

人工智能在工业生产中的新机遇

从历史的视角来看,前三次工业革命所依赖的主要动力来源于机械、电气和信息技术,这些技术展现出了显著的通用性。正如王海峰所指出的,当这些技术达到标准化、自动化和模块化的工业大规模生产特征时,便标志着核心技术迈入了工业化生产的新阶段。

如今,人工智能技术涵盖了算法、数据、模型和工具等方面,这些技术同样展现出了强大的通用性,并已具备标准化、模块化及自动化的特征。这一发展正推动着AI进入工业生产的新纪元。

Please specify source if reproduced文心大模型4.0 Turbo震撼登场!百度发布文心快码2.5新版本! | AI工具导航