功能实在太多,令人目不暇接。效率提升400%当然,其他功能虽然出色,但最令人震惊的仍是——Cursor终于拥有了自己的基础模型。值得一提的是,以前的Cursor虽然备受欢迎,但实际上仅仅是依赖于GPT或Claude的外壳,其能力并非Cursor本身所创造。而如今情况不同,Composer的到来让Cursor终于能够自信展现实力。难怪这次官网介绍显得格外坚定。(doge)Cursor表示,该模型专为低延迟编程而设计,能够在30秒内完成大部分交互任务。即使面对复杂庞大的代码库,依旧能保持高水平的推理和理解能力。除了精彩的演示,当然还需要通过Benchmark来展示实力。

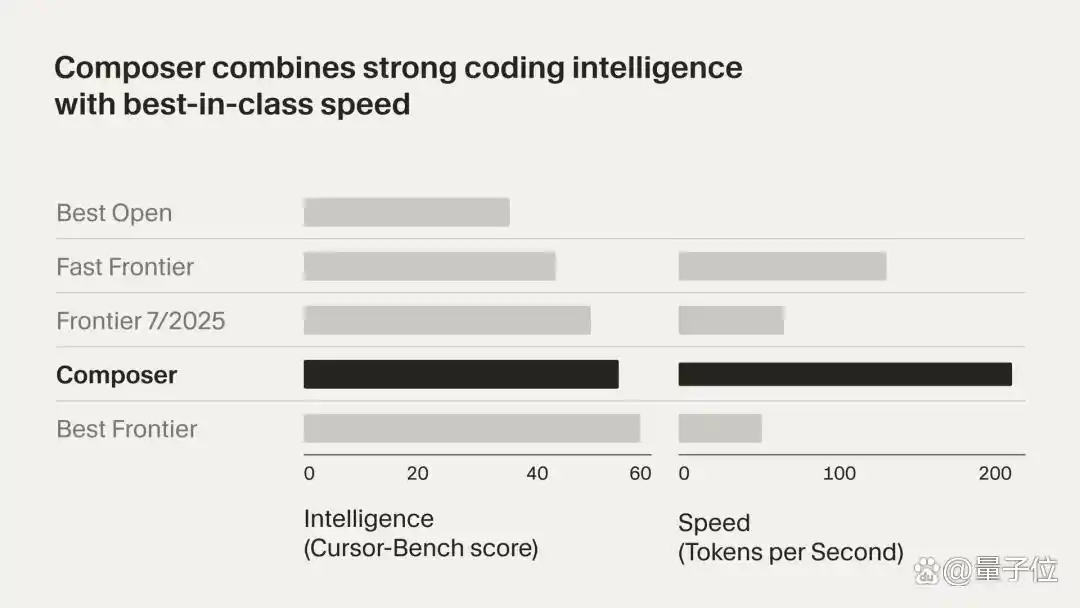

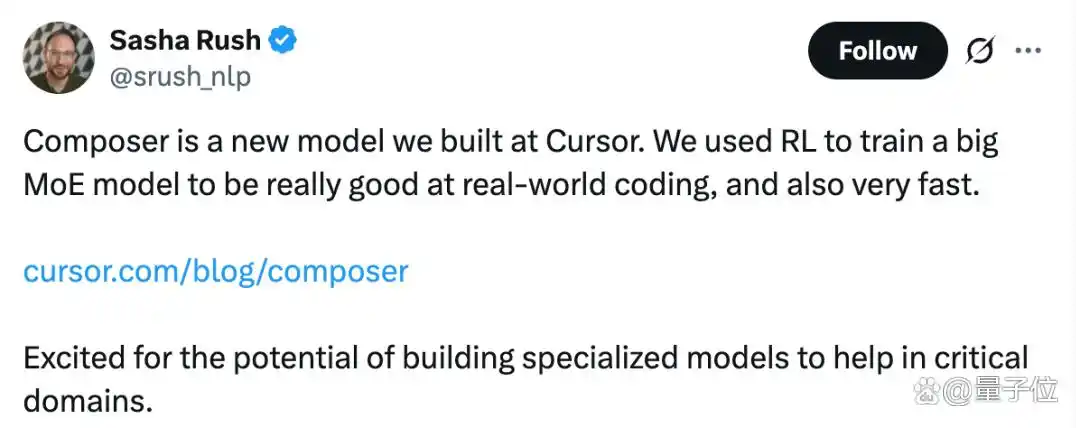

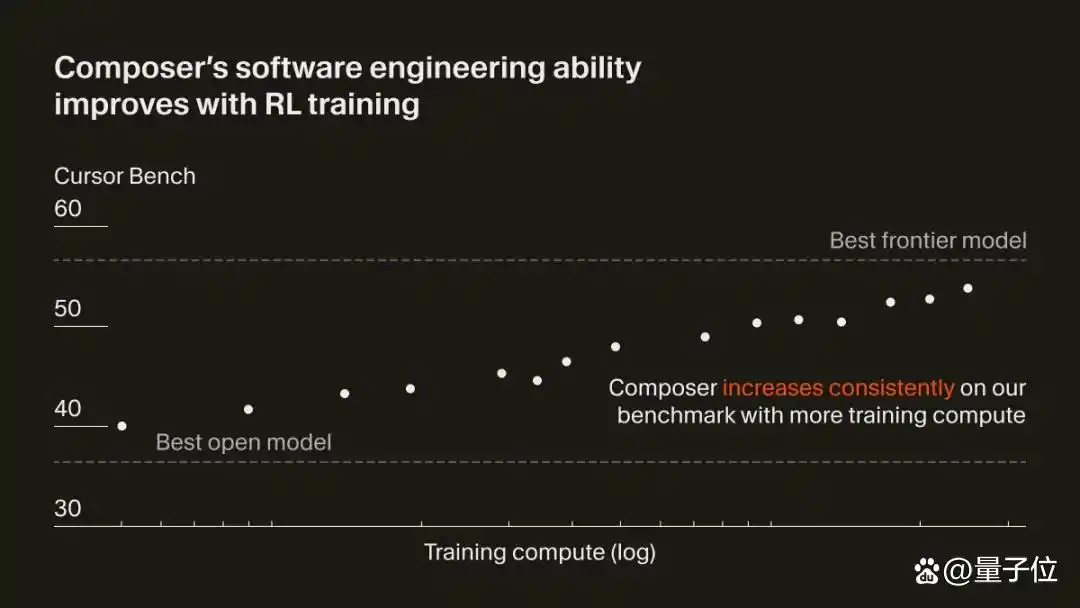

Composer的性能是通过内部测试套件「Cursor Bench」评测得出的——这一评估系统基于真实开发者的使用场景而设计。该Benchmark不仅测试代码的正确性,还考量模型的抽象层次、风格一致性与工程实践能力。结果显示:Composer以每秒250个tokens的速度生成代码。这速度相比当前最快的推理模型(如GPT-5、Claude Sonnet 4.5)快约两倍,而与其它模型相比更是快了四倍。尽管速度显著提升,Composer的灵活性依然不减,它的大幅提高推理能力与任务适应性,已达中等前沿模型的水准。自研基于强化学习的MoE模型如此惊人的表现,究竟是如何实现的呢?Cursor的研究科学家Sasha Rush揭示了答案——关键在于强化学习的应用。我们利用强化学习训练了一个大型MoE模型,使其更贴合实际编程任务,同时确保了速度的高效。

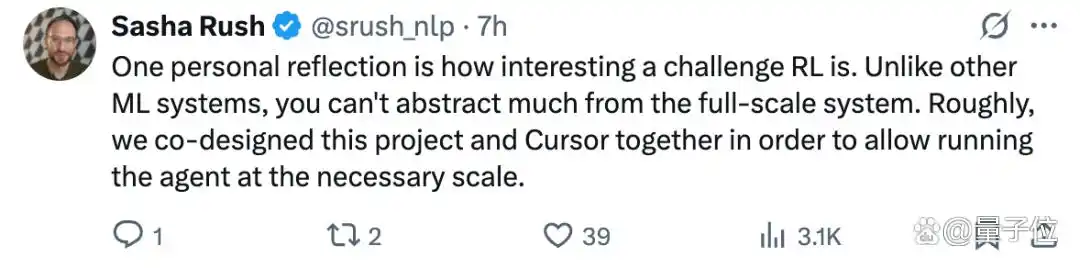

与此同时,Cursor充分发挥了自身在产品上的优势,与强化学习相辅相成。不同于其他机器学习方法,强化学习几乎无法从完整系统中提取过多信息。因此,我们让Composer与Cursor共同设计,以确保其在真实环境中高效运作。

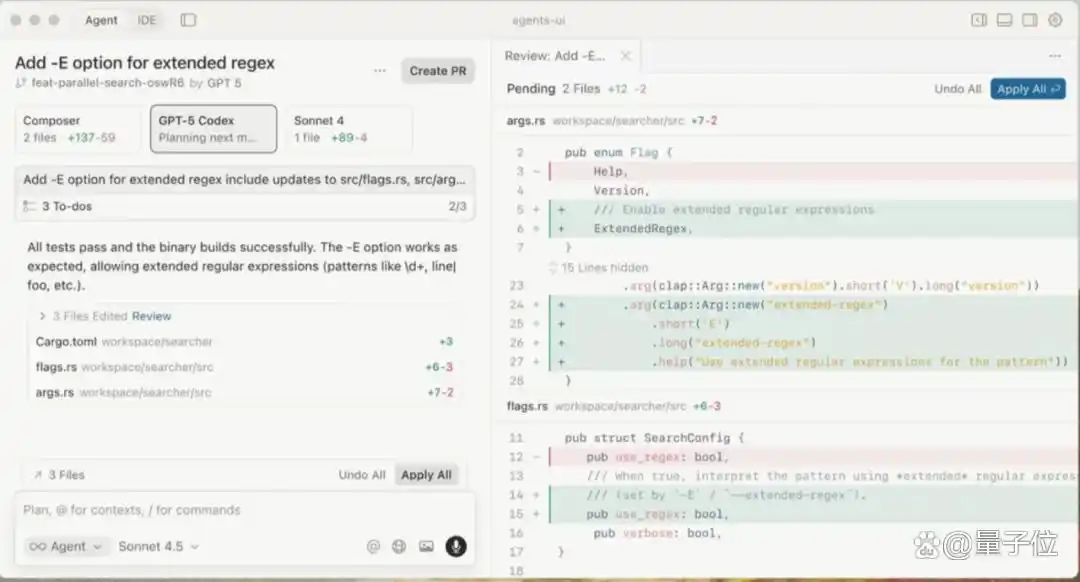

强化学习的一个显著特点是:必须在真实环境中“实践”,才能掌握真正的技能。如果Composer仅在虚拟数据集上做些修改,根本无法知道这些代码是否存在Bug,测试是否能通过。因此,Cursor让模型直接进入“实战”,在完整的Cursor环境中运行,使用工具、执行命令,通过多次真实交互获取最有效的反馈。具体而言,Composer的训练并不是基于静态数据集,而是围绕实际软件工程任务进行。在训练过程中,模型直接在完整的代码库中进行操作,使用生产级的工具:文件编辑、语义搜索、终端命令等……面对复杂的工程问题,模型必须自己编写、测试和修复代码。每次训练都对应一个具体任务,比如编写修改、拟定方案或解释特定的代码逻辑。事实证明,强化学习确实使得Composer的能力更上一层楼。它学会了如何聪明地选择工具,灵活地进行并行处理,不再随便给用户提供不实用的建议。随着训练的深入,模型甚至展现出涌现行为——能够自动运行单元测试、修复代码格式错误,甚至自主完成多步的代码搜索与调试过程。而Cursor 2.0这次为多Agent协作建立的基础架构,正是基于Composer的这些核心能力。

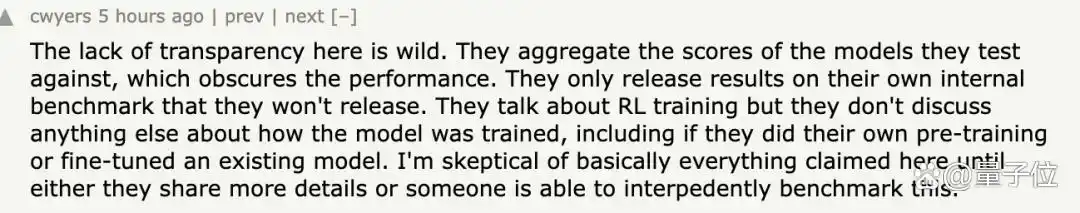

值得一提的是,这次Cursor所推出的并不只是一个速度更快的模型,而是一个真正能够应用于实际的人工智能系统。与其盲目地与那些顶尖的基础模型对抗,Cursor这次更加聪明地利用了其在应用层的产品优势——使Composer能够在与用户相同的环境中进行操作,真正实现了与开发者日常工作流程的无缝对接。Cursor,你的自研能力究竟如何?不过,从另一方面来看,Composer的表现确实令人惊艳,但Cursor似乎在有意避开一个重要议题——强化学习是没问题的,但请你明确模型的基础来源。关于Composer的透明度问题,简直让人感到匪夷所思。他们提到使用了强化学习,却没有说明模型的其他训练细节——究竟是自我预训练的,还是对现有模型进行了修改?在更详细的信息公开之前,或是有人能够独立验证结果之前,我对这些说法持谨慎态度。

Cursor的研究员Sasha Rush最近一直在Hacker News上积极回答问题,但对于“基础模型来源”这一询问,她始终没有给出直接的回应。在被询问“Composer是否是基于某个开源模型进行微调?”时,Rush的回答是:我们的重点主要集中在强化学习的后期训练阶段,认为这才是让模型成为强大交互智能体的最佳途径。不过,可以肯定的是,Cursor过去确实有自己的内部模型。据了解,Cheetah是Composer的早期版本,团队曾利用它来测试生成速度和系统集成效果。然而,正式版的Composer究竟是基于Cheetah,还是从开源模型的基础上进行了改进……仍需要继续观察一段时间~参考链接:[1]https://news.ycombinator.com/item?id=45748725[2]https://simonwillison.net/2025/Oct/29/cursor-composer/[3]https://venturebeat.com/ai/vibe-coding-platform-cursor-releases-first-in-house-llm-composer-promising[4]https://cursor.com/cn/blog/2-0[5]https://x.com/srush_nlp/status/1983572683355725869[6]https://x.com/cursor_ai/status/1983567619946147967

Please specify source if reproducedCursor推出首个编程大模型:实现250tokens/秒的极速代码生成,结合强化学习与MoE架构! | AI工具导航